챗GPT 열풍이 거세다. 많은 사람의 사용 후기가 SNS에 올라오며 화제가 되고 있다. 압도적 검색엔진 구글을 대체할 거라는 예측도 있다. 빌 게이츠에 따르면 챗GPT는 인터넷의 발명만큼 중요하다. 챗GPT 혹은 챗GPT의 원리는 인간의 음악 활동에 적용될 수 있을까.

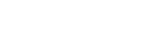

비언어 자료로서의 음악파일인간은 여러 대상을 학습하고 이해한다. 학습/이해의 대상들은 여러 형태로 표현된다. 문장이나 수식 등이 이해의 대상으로 가장 쉽고 분명해 보이는 표현들이다. 문장이나 문단, 더 나아가 어떤 책이나 논문, 기사의 내용 전체는 그것들을 접한 이가 이해했는지 아닌지를 판단하기가 상대적으로 쉽다. 챗GPT가 수학 문제도 좀 풀고 국어 문제와 영어 문제도 푸는 것은 챗GPT가 문장과 수식을 이해했기 때문이다.이런 이해 능력을 갖춘 챗GPT에게 “베토벤의 [운명 교향곡]에 대해 알려줘”라고 물으면 꽤 괜찮은 대답을 들려준다. 그런데 챗GPT에게 “베토벤의 [운명 교향곡] 1악장 첫 음은 무슨 음이지?”라고 질문하면 오류를 보였다. 다른 곡에서도 마찬가지였다. 베토벤의 [운명 교향곡]에 대한 텍스트는 많고, 챗GPT는 그 많은 텍스트를 열심히 학습했을 것이다. 그런데 [운명 교향곡]1악장의 첫 음이 솔이라는 사실을 거론하는 텍스트는 많지 않거나 없나 보다. [운명 교향곡]보다 덜 유명한 작품들의 첫 음이 무슨 음인지, 셋째 음은 뭔지, 그 음들을 어떤 악기들이 연주하는지 등에 대해 거론하는 텍스트 역시 많지 않거나 없나 보다. 사실은 전혀 없지는 않다. 음악학자가 [운명 교향곡] 등을 분석한 논문이나 책을 찾아보면 관련 문구가 있을 것이다. 챗GPT는 그런 문구를 다 기억하지 못하는 걸까?음악가들에게 텍스트는 책이나 논문뿐이 아니다. 그들에게 가장 중요한 텍스트는 악보다. 챗GPT는 악보를 공부하지 않았다. 그러니 “쇼팽의 [피아노 협주곡 2번]에서 피아노 파트 17번째 마디의 두 번째 음이 뭐지?”와 같은 질문에는 우매한 모습을 보일 것이다. 챗GPT는 음악에 관한 문장들은 학습하나, 인터넷상의 악보나 음악파일은 학습하지 않는다.인터넷은 엄청나게 많은 음원, 즉 음악파일의 바다다. 이 파일들을 분류하는 기술은 ‘음악정보검색(MIR: Music Information Retrieval)’이라는 분야에서 발달했다. 이 기술이 발전하면서 유튜브와 같은 플랫폼이나 인터넷상의 프로그램이 소비자에게 음악을 추천해줄 수 있게 되었다.음악정보검색 기술이 구현된 플랫폼이나 프로그램에서 챗GPT처럼 대화를 주고받으며 음악을 추천받는 일이 가능할까? 챗GPT에서 대화가 되면 음악 플랫폼이나 프로그램에서도 대화할 수 있다. 그런 곳에서 “비가 오는 날에 어울리는 음악 좀 추천해줘!”라고 말하거나 쓰면 그런 분위기에 어울리는 음악을 추천해준다. 이런 추천의 기저에는 어떤 음악이 비 오는 날에 어울리는지, 어떤 음악은 눈 오는 날에 어울리는지, 어떤 음악이 슬픈지, 어떤 음악이 경쾌한지 등의 기준들로 음악을 분류하는 기술, 즉 음악정보검색(MIR) 기술의 발달이 있다.이 기술의 기저에도 (챗GPT에서 사용되는) 언어 모델 인공지능이 있다. 언어 모델 인공지능에 결합한 음악정보검색 기술을 구현한 몇몇 플랫폼이나 프로그램에서 인간 소비자는 질문하고 플랫폼이나 프로그램은 결과물을 추천한다. 이런 플랫폼이나 프로그램의 사용자는 검색자가 아니다. 그는 물론 자판을 두들길 수 있다. 더 나아가 말을 하거나 노래를 부를 수도 있다. 노래 혹은 음향도 자판을 두드려 쓴 단어들처럼 질의어가 될 수 있기 때문이다. 이런 플랫폼이나 프로그램은 음악을 분류하고 추천하기 위해서 음악파일을 학습해야 한다.챗GPT가 음악파일을 학습하게 될까? 그렇게 될 것이다. 시간과 자본의 문제일 뿐이다. 챗GPT가 아닌, 덜 유명한 서비스 업체지만 음악파일을 학습하는 인공지능을 보유한 곳이 이미 있다. 그런 인공지능은 음악을 분류하고 추천하는 걸 넘어, 고객의 요구에 맞게 음악을 ‘생성(generation)’하기도 한다. 사실 챗GPT 개발자들도 챗GPT가 답변을 ‘생성’했다고 말한다(챗GPT에서 G는 Generative의 머리글자이다). “데카르트에 대해 알려줘”라고 물으면 그 질문에 따라 챗GPT가 답변을 생성하듯이, 인공지능의 음악 생성 역시 소비자의 언어에 따른다. 두 영역은 같은 언어 모델과 원리를 공유한다.겉으로 드러난 모습은 조금 다르다. “비 오는 날에 맞는 분위기의 음악을 추천해줘”라는 문장을 입력하면 그런 음악을 추천해주었다. 그리고 이제, “아케이드게임의 주요 사운드트랙으로서, 업비트이고 이상한 기타 반주를 가지며, 반복적이고 기억하기 쉬운 리듬의 음악. 심벌 크래시(crash)처럼 가끔 기대하지 않은 소리가 있는 음악을 만들어줘”라고 입력하면 실제로 그런 음악을 추천해주거나, 아예 생성해준다. ‘MusicLM’이라는 인공지능 프로젝트가 보여준 놀라운 성과다. MusicLM은 챗GPT가 멈춘 곳에서 언어 모델 인공지능의 성과를 보여준다. 구글이 만든 MusicLM은 아직 상용화되지 않았다.

※ 김진호는… 서울대학교 음악대학 작곡과와 동 대학교의 사회학과를 졸업한 후 프랑스 파리 4대학에서 음악학으로 박사학위를 취득했다. 국립안동대학교 음악과 교수로 재직 중이며, 『매혹의 음색』(갈무리, 2014)과 『모차르트 호모 사피엔스』(갈무리, 2017) 등의 저서가 있다.

Life

- 금주의 베스트 기사

- 01[2025 포브스코리아 30세 미만 30인] ENTERTAINMENT | 김희재(29) 가수

- 02[2025 포브스코리아 30세 미만 30인] ART&STYLE | 최제인(29) 글로니 대표

- 03기업 지원사업 파워 기관 TOP 40

- 04김종우 두산에너빌리티 원자력BG 상무 - ‘초격차’ 글로벌 SMR 파운드리로 우뚝

- 05[2025 포브스코리아 30세 미만 30인] SCIENCE | 김수민(26) 성균관대 지능형 정밀헬스케어 연구단 박사과정생

- 06[원전강국의 K-SMR③] 글로벌 SMR 합종연횡과 한국의 경쟁력

- 07[FORBES KOREA PICK IDOL&CELEB] 태생부터 프로 연예인인 아이돌·셀럽은?

- 08[원전강국의 K-SMR②] SMR 산업의 골든타임

- 09[2025 포브스코리아 30세 미만 30인] ENTERTAINMENT | 추영우(26) 배우

- 10[2025 포브스코리아 30세 미만 30인] ENTERTAINMENT | 비비(27) 가수·배우